在深度学习的Training阶段,由于对数据量及运算量需求巨大,单一处理器几乎不可能独立完成一个模型的训练过程,因此,Training环节目前只能在云端实现,在设备端做Training目前还不是很明确的需求。

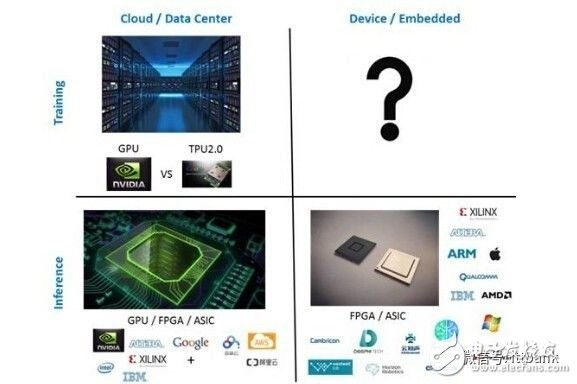

从应用场景来看,可以分成"Cloud/DataCenter(云端)"和"Device/Embedded(设备端)"两大类。

在深度学习的Training阶段,由于对数据量及运算量需求巨大,单一处理器几乎不可能独立完成一个模型的训练过程,因此,Training环节目前只能在云端实现,在设备端做Training目前还不是很明确的需求。

在Inference阶段,由于目前训练出来的深度神经网络模型大多仍非常复杂,其推理过程仍然是计算密集型和存储密集型的,若部署到资源有限的终端用户设备上难度很大,因此,云端推理目前在人工智能应用中需求更为明显。GPU、FPGA、ASIC(GoogleTPU1.0/2.0)等都已应用于云端Inference环境。在设备端Inference领域,由于

智能终端数量庞大且需求差异较大,如ADAS、VR等设备对实时性要求很高,推理过程不能交由云端完成,要求终端设备本身需要具备足够的推理计算能力,因此一些低功耗、低延迟、低成本的专用芯片也会有很大的市场需求。

按照上述两种分类,我们得出AI芯片分类象限如下图所示。